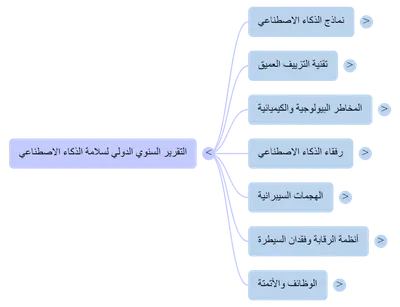

نظرة فاحصة التقرير السنوي لسلامة الذكاء الاصطناعي

حذّر التقرير السنوي الدولي لسلامة الذكاء الاصطناعي من المخاطر الناشئة التي تنطوي على استخدامات الذكاء الاصطناعي، خاصة ما يتعلق منها بعمليات الاحتيال والتزييف والمخاطر التنظيمية.

ويُعدّ مسحاً سنوياً للتقدم التكنولوجي والمخاطر التي يخلقها في مجالات متعددة، من التزييف العميق إلى سوق العمل.

وجاء التقرير، الذي صدر بقيادة عالم الحاسوب الكندي يوشوا بنجيو وشارك في كتابته أكثر من 100 خبير مستقل، ضمن سلسلة أُطلقت بعد قمة السلامة الدولية للذكاء الاصطناعي عام 2023.

ووصف التقرير التحديات الجسيمة التي تفرضها التطورات السريعة في مجال ، وفق صحيفة البريطانية.

وفيما يلي نستعرض أبرز النقاط الرئيسية التي أوردها تقرير سلامة الذكاء الاصطناعي:

1- نماذج الذكاء الاصطناعي

صدرت العام الماضي مجموعة واسعة من نماذج الذكاء الاصطناعي الجديدة، وهي التقنية التي تدعم أدوات مثل روبوتات المحادثة، بما في ذلك GPT-5 من شركة أوبن ايه آي، وClaude Opus 4.5 من شركة أنثروبيك، وGemini 3 التابع لشركة غوغل.

وأشار التقرير إلى أن أنظمة الاستدلال الجديدة، التي تحل المشكلات بتقسيمها إلى خطوات أصغر، أظهرت أداءً محسّنًا في الرياضيات والبرمجة والعلوم.

وقال عالم الحاسوب الكندي بنجيو إن هناك قفزة نوعية في عمليات الاستدلال بالذكاء الاصطناعي. وفي العام الماضي، حققت الأنظمة التي طورتها شركتا غوغل وأوبن ايه آي إنجازًا تاريخيًا بحصولها على الميدالية الذهبية في أولمبياد الرياضيات الدولي، وهو إنجاز غير مسبوق في مجال الذكاء الاصطناعي.

ومع ذلك، أشار التقرير إلى أن قدرات الذكاء الاصطناعي لا تزال غير مكتملة، في إشارة إلى أنظمة تُظهر براعة مذهلة في بعض المجالات دون غيرها.

فبينما تشهد أنظمة الذكاء الاصطناعي المتقدمة في الرياضيات والعلوم والبرمجة وإنشاء الصور تطورًا ملحوظًا، إلا أنها لا تزال عُرضة لإصدار بيانات خاطئة، أو ما يُعرف بـالهلوسات، ولا تستطيع تنفيذ مشاريع طويلة الأمد بشكل مستقل.

ومع ذلك، استشهد التقرير بدراسة تُظهر أن أنظمة الذكاء الاصطناعي تُحسّن قدرتها على تنفيذ مهام هندسة البرمجيات

ارسال الخبر الى: